OpenAI也「參團」強烈抨擊加州SB-1047法案

當地時間週三,OpenAI對加州一項旨在確保強大人工智慧安全部署的法案進行了猛擊抨擊,從而加入了包括史丹佛大學教授李飛飛、前百度首席科學家吳恩達等AI行業大佬的行列。反對者試圖趕在月底的州議會投票前,共同發動阻止法案通過的遊說狂潮…

根據業內媒體看到的一封週三寄給加州參議員Scott Wiener辦公室的信,OpenAI首席戰略官Jason Kwon在信中寫道,這項由議員Wiener牽頭髮起的SB-1047法案,將損害人工智能行業的創新。

OpenAI方面在信中認為,對此問題的監管應來自聯邦政府而非各州。同時也擔心,如果該法案獲得通過,可能會對美國的人工智慧競爭力和國家安全產生「廣泛而重大」的影響。

SB-1047法案於今年2月份在加州參議院首次被提出,該法案旨在為超過特定規模和成本門檻的大型人工智慧模型的公司,制定其所稱的「常識性安全標準」。法案將要求人工智慧公司採取措施,防止AI模型造成“嚴重危害”,如促成可造成大規模人員傷亡的生物武器的開發;或指示人工智慧模型策劃網路攻擊從而造成超過5億美元的損失。

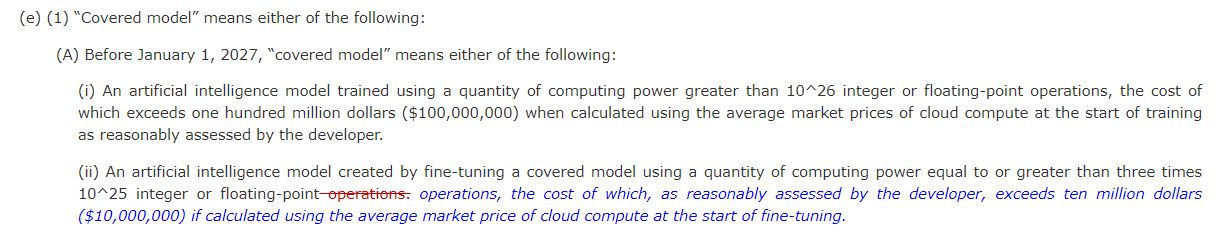

法案涵蓋的模型規模範圍如下:

在2027年1月1日之前,(i)使用超過10^26次整數或浮點運算的運算能力進行訓練的人工智慧模型,其成本超過一億美元——該成本是根據開發者合理評估的訓練開始時雲端運算的平均市場價格計算得出的。 (ii)利用等於或大於10^25次整數或浮點運算三倍的運算能力,對範圍內的模型進行微調而創建的人工智慧模型,其成本經開發者合理評估超過一千萬美元。

這範圍其實已基本涵蓋了現在市面上主流的大語言模型,OpenAI的GPT4模型顯然也在此列。因而如果法案通過,這些模型都將需要被額外監管。

根據這項SB-1047法案,企業需要確保AI系統可以隨時關閉,採取「合理的謹慎措施」確保AI模型不會造成災難,並向加州總檢察長披露合規聲明。如果企業不遵守這些要求,可能會被起訴並面臨民事處罰,若向該政府機構虛假陳述模型的功能,甚至可能最終使開發人員因偽證而入獄。

法案中還加入了吹哨人保護條款,保護和鼓勵AI開發實體內部的舉報者,確保員工可以在不受報復的情況下報告企業的不合規情況。

備受爭議

可以說,SB-1047法案在年內稍早一公佈,就遭到了許多大型科技公司、新創公司和創投家的激烈反對。

他們認為,對於一項仍處於起步階段的技術來說,該法案過於寬泛,可能會扼殺加州的科技創新。該法案的一些批評者也擔心,它可能會把人工智慧公司趕出加州。 OpenAI在最新給Wiener辦公室的信中也表達了同樣的擔憂。

Kwon在信中寫道,「人工智慧革命才剛開始,而加州作為人工智慧領域全球領導者的獨特地位,正在推動加州的經濟活力。SB-1047法案將威脅到這種成長,減緩創新步伐,並導致加州的世界級工程師和企業家離開當地,到其他地方尋找更大的機會。

OpenAI認為,白宮科技政策辦公室、商務部和國家安全委員會等聯邦機構,比加州州級政府機構更適合管理關鍵的人工智慧風險。該公司表示,它支持幾項擬議的聯邦立法,例如《人工智慧創新未來法案》,該法案為新的美國人工智慧安全研究所提供了國會支持。

據一位熟悉該公司房地產計劃的人士透露,由於擔心加州監管環境的不確定性,OpenAI已經擱置了擴建舊金山辦公室的討論,該人士要求匿名。

除OpenAI外,當前市場上的許多批評者也認為,該法案要求企業向州政府提交有關其模型的詳細信息,這將阻礙創新,同時也會阻止較小的開源開發者創建初創企業,因為他們害怕被起訴。

史丹佛大學教授、人工智慧知名學者李飛飛本月稍早就剛主導撰寫了一封聯名信。她表示,「加州的SB-1047法案將產生重大且意想不到的後果。如果通過成為法律,其將損害正在萌芽的人工智慧生態系統。SB-1047法案也將不必要地懲罰開發人員,扼殺開源社區,並阻礙人工智慧學術研究,同時仍無法解決其旨在解決的真正問題。

然而對於AI產業眼下愈發洶湧的反對者,該法案的發起者Wiener卻依然並不以為意。 Wiener在周三的最新回應中表示,他同意聯邦政府應發揮主導作用,但對國會是否會採取行動表示「懷疑」。

他也批評了市場上那些「陳腔濫調」的說法——如果該法案獲得通過,科技新創公司就會搬走,並表示總部設在州外的公司仍需遵守該法案,才能在當地開展業務。 Wiener在周三寫道:「底線是:SB-1047是一項非常合理的法案,它要求大型人工智慧實驗室做他們已經承諾要做的事情,即測試他們的大型模型是否存在災難性的安全風險。

據悉,加州議會將在本月底對該法案進行投票。如果獲得通過,加州州長紐森(Gavin Newsom)將決定是將其簽署為法律還是予以否決。